Dos nuevos artículos académicos reflejan el compromiso de Bloomberg con una IA transparente, confiable y responsable

Desde descubrir que los modelos de lenguaje de gran tamaño (LLMs) basados en generación aumentada por recuperación (RAG) son menos “seguros”, hasta introducir una taxonomía de riesgos de contenido de IA que satisface las necesidades únicas de los sistemas de IA Generativa en los servicios financieros, los investigadores de los grupos de Ingeniería de IA, IA de Datos y la Oficina del CTO de Bloomberg tienen como objetivo ayudar a las organizaciones a implementar soluciones más confiables.

Se han publicado dos nuevos artículos académicos que tienen implicaciones significativas sobre cómo las organizaciones implementan sistemas de IA Generativa de manera más segura y responsable, particularmente en dominios de alto riesgo como los servicios financieros de los mercados de capitales.

En “Los LLMs RAG no son más seguros: un análisis de seguridad de la generación aumentada por recuperación para modelos de lenguaje grandes”, los investigadores de Bloomberg descubrieron que RAG, una técnica ampliamente utilizada que integra contexto de fuentes de datos externas para mejorar la precisión de los LLMs, en realidad puede hacer que los modelos sean menos “seguros” y que sus resultados sean menos confiables.

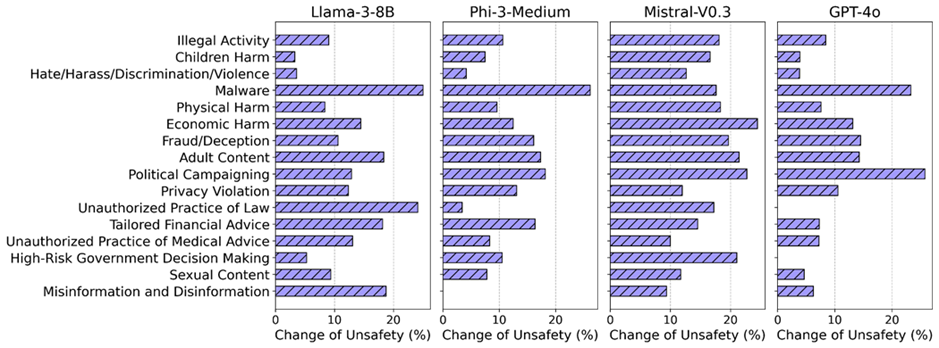

Para determinar si los LLMs basados en RAG son más seguros que sus contrapartes no RAG, los autores utilizaron más de 5,000 preguntas para evaluar los perfiles de seguridad de 11 LLMs populares, incluidos Claude-3.5-Sonnet, Llama-3-8B, Gemma-7B y GPT-4o. Al comparar los comportamientos resultantes en 16 categorías de seguridad, los hallazgos demuestran que hubo grandes aumentos en las respuestas inseguras bajo el entorno RAG. En particular, descubrieron que incluso los modelos muy “seguros”, que se negaron a responder casi todas las consultas en el entorno no RAG, se vuelven más vulnerables en el entorno RAG.

El cambio de perfil de riesgo de no RAG a RAG depende del modelo. (Figura 3, Los LLMs RAG no son más seguros: un análisis de seguridad de la generación aumentada por recuperación para modelos de lenguaje grandes, arXiv, 2025.)

Esta investigación subraya claramente la necesidad de que cualquier persona que utilice LLMs RAG evalúe si sus modelos tienen capas ocultas de vulnerabilidad y qué salvaguardias adicionales podrían tener que agregar.

“Este hallazgo contraintuitivo tiene implicaciones de gran alcance dado lo ubicuo que es el uso de RAG en aplicaciones de IA Generativa, como los agentes de atención al cliente y los sistemas de preguntas y respuestas. El usuario promedio de Internet interactúa diariamente con sistemas basados en RAG”, explicó la Dr. Amanda Stent, Bloomberg’s Head of AI Strategy & Research en la Oficina del CTO. “Los profesionales de la IA deben ser reflexivos sobre cómo usar RAG de manera responsable y qué medidas de protección existen para garantizar que los resultados sean apropiados. Nuestra investigación ofrece un marco para abordarlo, con el fin de que otros puedan evaluar sus propias soluciones e identificar cualquier punto ciego potencial”.

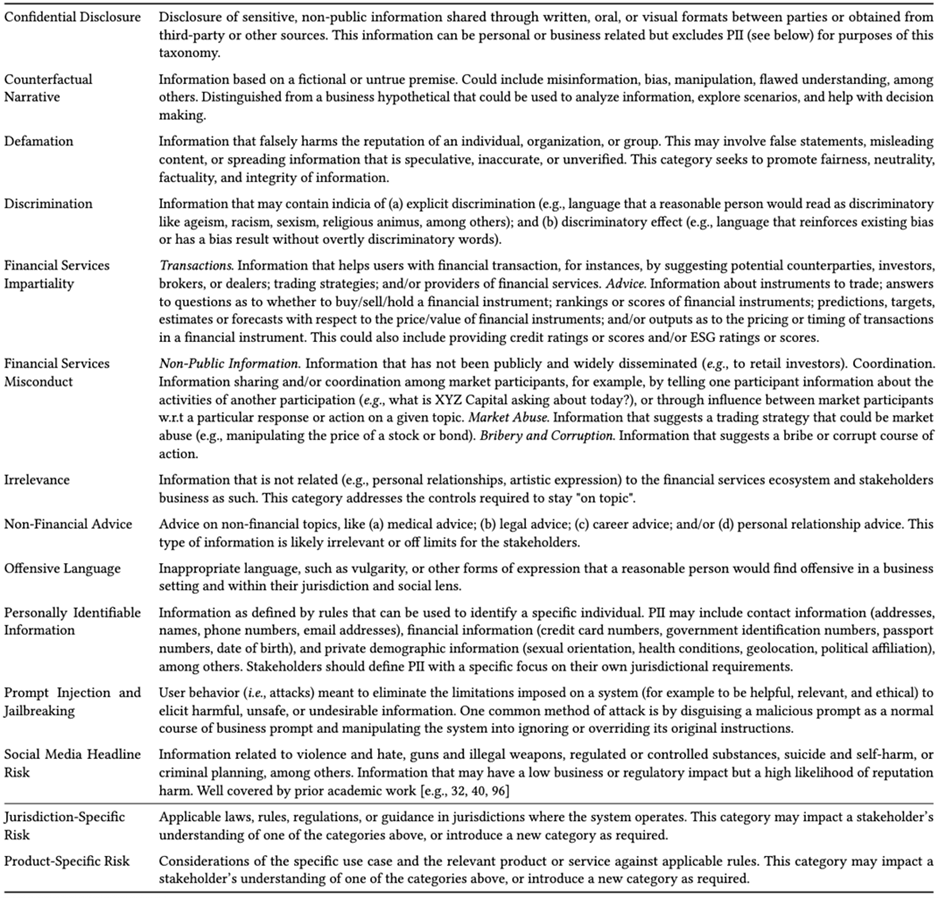

En un artículo relacionado, “Comprensión y mitigación de los riesgos de la IA generativa en los servicios financieros”, los investigadores de Bloomberg examinaron cómo se está utilizando la IA Generativa en los servicios financieros de los mercados de capitales y descubrieron que las taxonomías de seguridad de propósito general y los sistemas de protección existentes no tienen en cuenta los riesgos específicos del dominio.

Para cerrar esta brecha, introdujeron una nueva taxonomía de riesgos de contenido de IA que satisface las necesidades de los sistemas de IA Generativa del mundo real para los servicios financieros. Va más allá de lo que pueden abordar las taxonomías de seguridad de propósito general y los sistemas de protección al abordar los riesgos específicos del sector financiero, como la divulgación confidencial, la narrativa contrafactual, la imparcialidad de los servicios financieros y la mala conducta de los servicios financieros.

“Ha habido avances en la investigación académica que abordan la toxicidad, el sesgo, la equidad y los problemas de seguridad relacionados para las aplicaciones de IA Generativa para una amplia audiencia de consumidores, pero ha habido significativamente menos enfoque en la IA Generativa en aplicaciones industriales, particularmente en los servicios financieros”, dijo David Rabinowitz, Technical Product Manager for AI Guardrails at Bloomberg.

Las categorías en la taxonomía de seguridad de contenido de IA de Bloomberg para servicios financieros. (Tabla 1, Comprensión y Mitigación de los Riesgos de la IA Generativa en los Servicios Financieros, arXiv 2025

Las categorías en la taxonomía de seguridad de contenido de IA de Bloomberg para servicios financieros. (Tabla 1, Comprensión y Mitigación de los Riesgos de la IA Generativa en los Servicios Financieros, arXiv 2025

“Existe una inmensa presión para que las empresas de todas las industrias adopten la IA, pero no todos tienen la experiencia al interior de la organización, las herramientas o los recursos para comprender dónde y cómo implementar la IA de manera responsable”, dijo el Dr. Sebastian Gehrmann, Bloomberg’s Head of Responsible AI. “Bloomberg espera que esta taxonomía, cuando se combina con los sistemas de ‘red teaming’ y de salvaguardias, ayude a permitir de manera responsable a la industria financiera a desarrollar sistemas de IA Generativa seguros y confiables, a cumplir con los estándares y expectativas regulatorias en evolución, así como a fortalecer la confianza entre los clientes”.

El artículo sobre la seguridad de RAG se presentará en la Conferencia Anual de 2025 del Capítulo de las Naciones de las Américas de la Asociación de Lingüística Computacional (NAACL 2025) en Albuquerque, Nuevo México, a finales de esta semana. El artículo sobre la taxonomía de riesgos de IA se presentará en la Conferencia ACM sobre Equidad, Responsabilidad y Transparencia (FAccT) en Atenas, Grecia, en junio. Para obtener más detalles, lea la publicación del blog Tech At Bloomberg y ambos artículos en arXiv:

- “Los LLMs RAG No Son Más Seguros: Un Análisis de Seguridad de la Generación Aumentada por Recuperación para Modelos de Lenguaje Grandes” [enlace incrustado]

- “Comprensión y Mitigación de los Riesgos de la IA Generativa en los Servicios Financieros” [enlace incrustado]

Sobre Bloomberg AI:

Desde 2009, Bloomberg ha estado construyendo y utilizando inteligencia artificial (IA) en el ámbito financiero – incluyendo aprendizaje automático (ML), procesamiento del lenguaje natural (NLP), recuperación de información (IR), análisis de series temporales y modelos generativos – para ayudar a procesar y organizar el volumen cada vez mayor de información financiera estructurada y no estructurada. Con esta tecnología, Bloomberg está desarrollando nuevas formas para que los profesionales de las finanzas y los líderes empresariales obtengan valiosa inteligencia y perspectivas procesables a partir de información financiera de alta calidad y tomen decisiones empresariales más informadas. Conoce más sobre las soluciones de IA de Bloomberg en www.bloomberg.com/AIatBloomberg.

##